Політичні діпфейки як нова зброя: як маніпуляції підривають довіру виборців в Угорщині

В Угорщині виборчий процес входить у нову фазу цифрової трансформації. Політична боротьба дедалі активніше переходить у сферу віртуальних маніпуляцій. Як правляча партія, так і опозиційні сили використовують технологію діпфейків, створених штучним інтелектом, для поширення контенту, що дискредитує суперників.

Експерти з інформаційної безпеки застерігають, що подібні матеріали — поєднання технологічної достовірності та емоційного впливу — формують викривлене сприйняття подій, підриваючи довіру до традиційних медіа та демократичних інститутів. Аналітики наголошують: діпфейки стають не просто інструментом політичної пропаганди, а новим чинником ризику для стабільності виборчих процесів у всій Європі.

Штучний інтелект як інструмент виборчої кампанії

Штучний інтелект поступово перетворюється на інструмент стратегічного впливу в політичній боротьбі Угорщини. Як правляча партія прем’єр-міністра Віктора Орбана, так і опозиційні сили активно використовують технології генеративного ШІ для створення агітаційного та пропагандистського контенту. Водночас значна частина цього матеріалу публікується без відповідного маркування, що унеможливлює для виборців розуміння його штучного походження та посилює ризики дезінформації.

Найбільш резонансним прикладом став діпфейк-відеоролик, на якому зображено нібито угорських солдатів, що повертаються з України у трунах. Цей матеріал, створений за допомогою ШІ, активно поширювався у соціальних мережах і навіть транслювався державним телебаченням. Відповідний ролик з'явився на офіційній сторінці Віктора Орбана у фейсбук.

Відео з’явилося в інформаційному просторі саме напередодні завершення голосування поштою щодо питання вступу України до Європейського Союзу, що свідчить про його потенційне використання як інструменту політичного впливу на громадську думку.

Аналітики зазначають, що подібні випадки сигналізують про зміщення меж між політичною комунікацією та маніпуляцією, коли емоційно навантажений, але штучно створений контент може визначати політичні настрої суспільства. У ширшій перспективі це ставить питання про необхідність регулювання використання ШІ у передвиборчих кампаніях і впровадження стандартів прозорості, аби зберегти довіру до демократичних процесів.

Мільйони євро на онлайн-рекламу

Феномен політичної дезінформації в Угорщині набуває системного характеру. Ключову роль у поширенні діпфейк-матеріалів відіграє Національний рух опору (NEM) — організація, що відкрито підтримує правлячу партію Фідес. Від червня вона інвестувала понад 1,5 млн. євро у політичну рекламу на платформах Facebook та YouTube. За даними, наданими компаніями Meta і Google, це — наймасштабніша політична рекламна кампанія з використанням ШІ в межах Європейського Союзу.

Опубліковані матеріали містили діпфейки із зображенням лідера опозиції Петера Мадяра, а також вигадані цитати, спрямовані на дискредитацію його політичних ініціатив. Частина контенту використовувала створених штучним інтелектом персонажів, які демонстрували нібито суспільну підтримку позицій уряду Віктора Орбана — зокрема щодо міжнародної політики та відносин з ЄС.

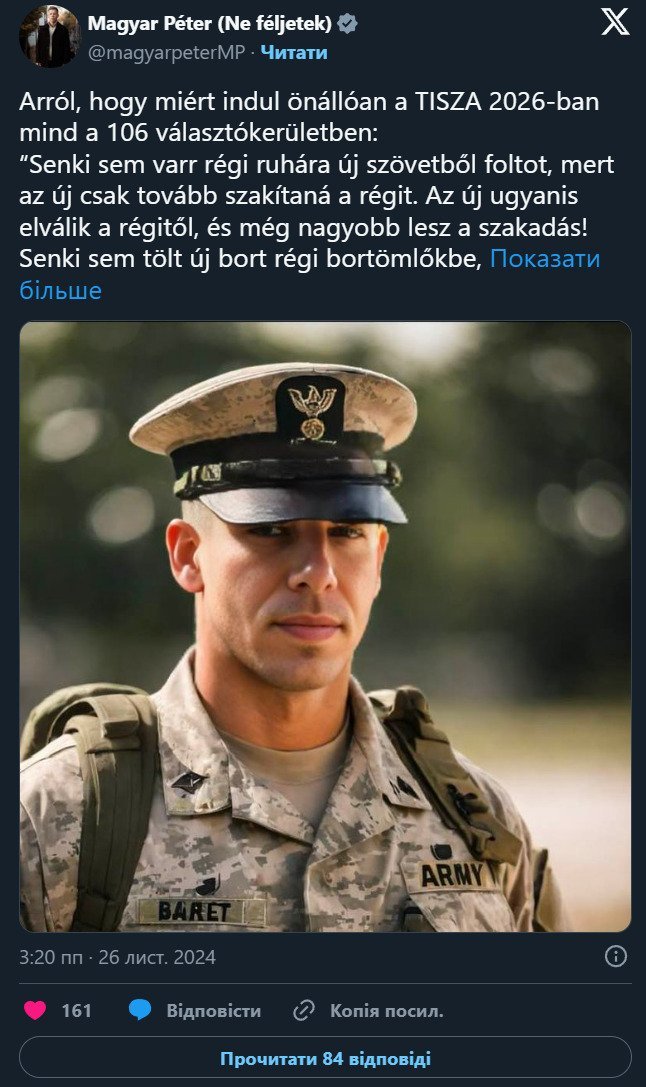

Попри це, опозиційний табір також не відмовився від ШІ-технологій. Сам Петер Мадяр визнав, що застосовував штучний інтелект у межах своєї медіастратегії. Одним із прикладів стала опублікована ним фотографія у військовій формі, створена за допомогою генеративних алгоритмів. Політик, однак, підкреслив, що етичне використання ШІ можливе лише за умови відкритого маркування контенту та поінформованості аудиторії про його штучне походження.

Мадяр розкритикував дії партії Фідес і пов’язаних із нею структур, наголосивши, що поширення неромаркованих діпфейків є формою виборчої маніпуляції, яка підриває довіру громадян до демократичного процесу.

Аналітики вважають, що ситуація в Угорщині демонструє нову модель політичної комунікації, у якій технології ШІ використовуються не лише як інструмент маркетингу, а й як засіб інформаційного контролю та впливу на електорат. Це створює небезпечний прецедент для інших країн ЄС, де подібні технології можуть бути інтегровані в кампанії без належного регулювання чи етичних стандартів.

Де межа істини?

Позиція уряду щодо використання штучного інтелекту в політичній комунікації залишається суперечливою. Офіційно представники влади заявляють, що застосування контенту, створеного ШІ, є допустимим лише за умови чіткого маркування та прозорого інформування аудиторії. Водночас незалежні журналісти фіксують численні випадки відсутності такого маркування, що свідчить про системні порушення етичних принципів цифрової комунікації.

У відповідь на зростаючу критику уряд анонсував розробку національного кодексу етики щодо використання штучного інтелекту. Комісар з питань ШІ Ласло Палкович запевнив, що Угорщина підтримує положення Закону ЄС про штучний інтелект (AI Act), який передбачає підвищені стандарти прозорості та підзвітності в застосуванні генеративних технологій. Водночас він наголосив, що рішення про використання ШІ залишається на розсуд кожного політика, що фактично перекладає відповідальність за етичність контенту на окремих учасників виборчого процесу.

Експерти відзначають, що така позиція демонструє розрив між нормативними деклараціями та практичною імплементацією принципів етичного використання ШІ. Відсутність централізованого контролю створює умови для подальших зловживань, коли технології ШІ використовуються як інструмент політичного тиску та дезінформації.

Паралельно, у відповідь на зростання кількості маніпуляцій, компанії Meta та Google тимчасово призупинили розміщення політичної реклами в Європейському Союзі. Це рішення пов’язане із впровадженням нових регуляторних вимог ЄС, які зобов’язують чітко маркувати спонсорований контент і забороняють таргетовану рекламу під час виборчих кампаній.

Аналітики вбачають у цьому кроці спробу технологічних гігантів захистити власну репутацію та мінімізувати ризики політичних маніпуляцій, але також наголошують, що повна ефективність таких обмежень можлива лише за умови узгодженої взаємодії між національними урядами, регуляторами та платформами. У випадку Угорщини нинішня політична практика демонструє, що технологічна модернізація без етичних гарантій може перетворитися на інструмент підриву довіри до демократичних інститутів.

Вибори в тіні дезінформації

Парламентські вибори в Угорщині, заплановані на квітень 2026 року, відбуватимуться в умовах глибокої цифрової трансформації політичних комунікацій. Широке впровадження технологій штучного інтелекту у виборчих кампаніях уже сьогодні ставить під сумнів прозорість виборчого процесу, а також стійкість демократичних інститутів до цифрової дезінформації. Замість традиційних форм політичного протистояння все частіше спостерігається змагання за інформаційний контроль, у якому перевагу отримують ті, хто ефективніше використовує алгоритми й емоційні маніпуляції.

Медіаексперти застерігають, що контент, згенерований штучним інтелектом, має особливо сильний емоційний потенціал. Реалістичні діпфейки здатні викликати гострі психологічні реакції — від обурення до співчуття — створюючи враження достовірності навіть за повної відсутності фактів. У поєднанні з алгоритмічними механізмами соціальних мереж, які просувають найбільш «залучальний» контент, такі матеріали швидко набувають вірусного ефекту, формуючи спотворену картину політичної реальності.

Аналітики наголошують, що цей ефект підсилення через цифрові платформи створює нову форму інформаційної асиметрії: виборець опиняється в середовищі, де емоційно навантажені, але маніпулятивні повідомлення витісняють збалансовану інформацію. У результаті суспільство стає більш вразливим до керованої дезінформації, а демократичний процес — менш передбачуваним і менш підзвітним.

Таким чином, вибори 2026 року можуть стати тестом не лише для угорської демократії, а й для всієї європейської системи політичної комунікації: наскільки вона готова до викликів, що постають на перетині технологій, етики та громадської довіри.

В Україні , де на величезні гроші демократичних європейських країн по-факту швидко розбудовується диктатура значно гірша за диктатуру в Мацковії , з якою воюємо, тільки неадекватніх людей буде цікавити те , як там всякі Орбани та Фіцо маніпулюють своїми виборцями, щоб залишитись при владі.

Щось я завжди вважав, що рухи опору мають опозиційний до чинної влади характер.

Відстав я від життя.

Зараз війна нового типу - емоційна.

Перемога запалестинців - оце воно і є.

Як в поп-музиці, на відміну від класичного року.

Спробуйте проаналізувати текст більшості поп-композицій з логічної точки зору, тобто спробуйте на основі тексту пісні збудувати сцену. Якщо спробуєте точно - збожеволієте. Якщо спробуєте якось - вийде купа слабко пов'язаних абстракцій (що і бачимо у офіційних каверах).

Щось подібне буде відбуватись і з цими технологіями.

Хто набере найяскравішу комбінацію з образів "легко", "ворог", "халява" і тому подібних - той і виграв.

В перемозі "запалестинців" мабуть більше галасу, ніж реальних здобутків. Та й емоції, які демонструються, не завжди є справжніми. Приклад - чужі емоції акторів у театральних спектаклях, коли вони, на очах у глядачів, грають ролі інших особистостей, тимчасово "витісняючи" власну особистість із своєї свідомості. Всі знають, що це фейк, але глядачам подобається талановита акторська гра...

Як у нас з дронами: колись були допоміжними засобами, а тепер вони визначають увесь фронт.

Запалестинці емоційними впливами змусили миттєво забути про їх звірства і їх радість цим звірствам 7 жовтня, миттєво перемкнувшись з хижака на жертву. І світ - забув та повірив.

Тут пряма асоціація з 2 травня в Одесі: програвши битву за город, начепили на себе маски мучеників.

Тільки ми не настільки суб'єктивні, як Захід, тому нас цим (і запалестинством) не проб'єш.

Вплинула і змусила цілеспрямована матеріальна, моральна та політична підтримка палестинських "біженців", їх цивільних та бойових організацій багатьма мусульманськими країнами та європейськими урядами, в тому числі РФ. На їх гроші проведені ІПСО, на які Ізраїль виявився нездатним адекватно відповісти. Картини зруйнованої ізраїлем Гази - широкий потік, а фото тіл, спалених хамасівцями 7 жовтня єврейських дітей у кібуцах, в Європі не побачиш щодня у європейських ЗМІ...маленький струмочок єврейських сліз...

Тому - фактична перемога на боці ХАМАС (їм повернули Газу), концептуальна - на боці русні (технології спрацювали на ура).

А базується це все на чому? На емоційності жителів Заходу.

От, до речі, Мовчан, що перший коментар написав.

Він же хитрий, як змій.

Людей, що пишуть на цієї статті, тут, на Цензорі, по пальцях перелічити. Пекар і Світлик. Ще є хтось з інституту морської аналітики, але там вузька експертиза.

Мовчан своїм закликом до автора "писати про пересічних для пересічних" намагається, "заземливши" вас, втримати нас всіх на рівні дитячої свідомості.

Яка, як відомо, не оперує абстракціями, тільки конкретикою. І має емоційний, а не логічний примат прийняття рішень.

В той час як у деякої частини русні (зокрема тієї, що працює по лінії інформаційної війни) дуже добре розвинута доросла свідомість. З абстракціями, ідеями, концептами, рефлексією.

Ця асиметрія рівнів для нас виливається в результати виборів-19, а для США - у результати виборів-24.

Пан Мовчан не просто коментує тему - він змінює рівень розмови.

Заклик «писати про пересічних для пересічних» - це не турбота про актуальність, а спроба заземлити мислення, перевести його з аналітичного рівня в побутовий.

Дитяча свідомість не працює з абстракціями, вона реагує лише на конкретику й емоції.

Тому, поки ми залишаємося в межах «що відчувають пересічні», ми не можемо побачити, як ці відчуття формуються - ким, якими інструментами, з якою метою.

Ті, хто веде інформаційну війну проти нас, якраз і працюють у площині дорослого мислення: з концептами, моделями, емоційними архітектурами.

І коли нас «заземлюють» у конкретику, нас позбавляють можливості мислити системно - тобто захищатися.

Через вкрай слабий рівень ізраїльських політиків, потужна ізраїльска армія не довела справу до кінця, не обеззброїла злочинців у Газі і не відправила їх у тюрми.

Хіба мало мешканців Гази зараз змушені емоційно демонструвати підтримку хамасу, бо інакше є великий ризик закінчити своє життя на площах Гази від ударів бейсбольними битами або від куль хамасівських катів, яких сватають тепер у "сили безпеки" мирної Гази... Отака ціна і справжня причина "лікування" палестинців...

Операція "Залізні мечі" почалася 7 жовтня 2023 року у відповідь на напад ХАМАСу та її ключова фаза під назвою "Колісниця Гідеона" (у травні 2025 року), були спрямовані на захоплення значних територій (близько 65-75% Гази) та остаточне послаблення ХАМАСу і завершилася в серпні 2025 без повного досягнення цілей, але з територіальними здобутками.

Більшість джерел (включаючи ізраїльські, американські та західні) вважають, що Ізраїль досяг стратегічної перемоги, послабивши ХАМАС до критичного рівня, тоді як ХАМАС зазнав значних втрат, але зберіг певний вплив.

Ключові аргументи на основі поточного статусу:

1)ХАМАС втратив більшість лідерів (включаючи Ісмаїла Ханію та Яхью Сінвара), значну частину бійців (з 40 000 до менш ніж 10 000 активних), інфраструктуру у Газі (тунелі, склади зброї та здатність до масованих атак).

2)Звільнено всіх живих заручників (20 останніх - у жовтні 2025) та частину тіл загиблих (9 з 28).

3)Ізраїль контролює понад 50% території Гази (після часткового виведення військ), що дозволяє диктувати умови безпеки.

4)Економічні та військові втрати ХАМАСу оцінюються в мільярди доларів; організація визнана "серйозно послабленою" та "нездатною до повноцінного управління Газою".

Поточний статус (жовтень 2025):

10 жовтня 2025 набуло чинності третє перемир'я за посередництва США (план Трампа від вересня 2025 з 20 пунктів), що включаючає припинення вогню, обмін заручниками/в'язнями, виведення військ з частини Гази та альтернативне управління Газою - без ХАМАСу, за участю арабських країн.

Станом на 16 жовтня перемир'я тримається з поверненням палестинців до домівок, надходженням допомоги (400 вантажівок/день) та самітом миру в Шарм-ель-Шейху (13 жовтня). ХАМАС звільнив заручників, Ізраїль - 2000 палестинських в'язнів.

Експерти (NPR, NYT, Al Jazeera) називають це "кінець війни", але з ризиками.

ХАМАС звинувачує Ізраїль у порушеннях, Трамп погрожує "ліквідацією" решток ХАМАСу. Ізраїль зберігає контроль над периметром Гази.

І де тут перемога ХАМАСу? Точніше було б вказати, що Ізраїль міг і зобовʼязаний був досягти більш вагомої перемоги над ХАМАС, але через "миротворче" втручання США був змушений тимчасово відмовитися від досягнення запланованих результатів.

Ризик продовження війни все ще зберігається.

Це і є перемога.

ХАМАС швидко відновиться на єврогрошах і завдяки маткам палестинських жінок.

А у мене одне питання: ви, як і Мовчан, намагаєтесь "заземлити" думку - свідомо, чи ні?

Їх очільники політики- популісти, свому житті особисто "не будували навіть собачої будки".

А "палестинські біженці"- майбутні громадяни "держави", в своїй масі та ХАМАС і без цього непогано влаштувались за рахунок коштів інших країн. Спробуйте краще уявити, що таке "збудувати" державу?

Цей мій коментар не має на меті "заземлити" вашу особисту думку

Угорщина - лише приклад, як можна за допомогою ШІ будувати політичні ілюзії.

Так і русняві технологи через ХАМАС побудували емоційні ілюзії, де терористи - це жертви, а жертви - це терористи (ордери МКС на арешт Нетаньяху і Галанта - справжні, як і срач в університетських кампусах світу, який розвели запалестинці суто в рамках захисту своїх прав).

Політтехнологія, яку ви описуєте, називається "інверсія наративу" або "перевертання ролей" (англ. narrative inversion чи victim-perpetrator reversal). У політології та медіа-аналізі частіше використовують термін "маніпуляція наративом" або "фреймінг" (від англ. framing), коли свідомо змінюють сприйняття сторін конфлікту, щоб жертва виглядала агресором, а агресор - жертвою. Як це працює? Механізм: використовується пропаганда, дезінформація чи вибіркове висвітлення фактів у медіа, щоб перекрутити контекст подій. Наприклад, акцентують на діях жертви (самооборона, протест) як на "агресії", ігноруючи причини, а дії терориста/агресора виправдовують як "захист" чи "спровоковану реакцію".

Які інструменти використовують? 1)медіа-фреймінг - вибіркове цитування, маніпуляція зображеннями чи відео (наприклад, показ лише наслідків дій жертви, без контексту). 2)Дезінформація - поширення фейків чи перекручених фактів, щоб звинуватити жертву.

3)Риторика - використання термінів на кшталт "терорист", "екстреміст" для жертви, або "борці за свободу", "захисники" для агресора.

Газлайтинг- переконування аудиторії, що їхнє сприйняття реальності хибне.

Приклади:

Конфлікт Ізраїль-ХАМАС (2023-2025). Деякі медіа чи сторони можуть подавати дії Ізраїлю (як відповідь на атаки ХАМАСу) як "непропорційну агресію", а ХАМАС - як "жертву окупації", або навпаки - Ізраїль як "жертву тероризму", а палестинців як "терористів". Залежить від джерела та його упередженості.

Російська пропаганда часто зображує Україну як "агресора" чи "нацистів", які "спровокували" вторгнення, а Росію - як "жертву", що "захищається".

А Мовчан дає майже пряму вказівку Світлику: не лізь сюди, хохлодіточкам не треба таким головки вантажити, нехай вони будуть і далі хохлодіточками. Не дивіться вгору, коротше. Бо так всім зручніше.

Я саме так і намагаюсь сприймати і реагувати на коментарі , чого і вам бажаю. До речі, ваші коментарі читаю із цікавістю.

FYI. З коментатором (з ніком Мовчан) - тим, якого ви у коментарі назвали "хитрим, як змій", я не знайомий, але ніки "змій" точно є серед авторів коментів на Цензорі

Цікаво, навіщо?

Ви теж "хитрий як змій"?

https://www.village.com.ua/village/business/news/361577-openai-pochala-testuvati-vodyani-znaki-na-zobrazhennyah-iz-chatgpt

Окрім захисту від підробки та від приховування чи відмови від авторства, разом з традиційним ЕЦП, застосовується АI, спеціально навчений та призначений для пошуку та ідентифікації фейків. Людина самостійно вже не здатна надійно відрізнити професійно виконаний фейк, обʼєкт-підробку чи копію від справжнього, оригінального обʼєкту. На черзі AI -застосунки та сервіси, яки автоматично фільтруватимуть фейки, блокуватимуть можливість їх розповсюдження через інтернет.

Схоже, все, пропонується людині, тепер повинно розглядатися, як обʼєкти і навіть субʼєкти (як от - двійники путлєра) з "параноїдальним", нулевим рівнем довіри. Ретельно перевіряти слід все. І не завадить пригадати Бісмарка, якому, як багато хто вважає, належать слова: «Es wird niemals so viel gelogen wie vor der Wahl, während des Krieges und nach der Jagd» (Ніколи не буде стільки брехні, як до виборів, під час війни та після полювання)

На великому розмірі контенту, створеному певним ШІ, знайти без спеціальних засобів та методів цілеспрямовано вбудований "захист" в реальному часі практично неможливо. Адже він може бути і семантичним. Діпфейки дійсно є, і пропозиція поширюється, бо на них є платоспроможний попит і зацікавленість політиків і криміналу. IMHO, необхідна політична воля, підвищення відповідальності та свідомості, і діпфейки зникнуть.

https://www.claila.com/uk/blog/legko-vidalit-vodanij-znak-ai-ta-otrimajte-profesijni-rezul-tati-za-liceni-sekundi

лідери ЗМІ теж цим займаються - от в чому в чому, а в цьому трамп правий, фейк ньюс повсюди

технічна компонента викликає більше довіри пліткам тільки тому, що ******* молодь взагалі більше цікавиться інтернетом, і ще тому що мозок заточений більш довіряти очам, ніж вухам чи тексту

Згадавши про "зіроу-траст", вмикаєте на свому смартфоні надійний застосунок з AI - агентом, який швидко робить експертизу медіаконтенту на наявність різних прихованих маркувань.

Отримуєте відповідь, щось на кшалт - контент створено ШІ з імовірністю 90%, маркування намагалися видалити...